2024 Google I/O 发布会汇总

来源:有新Newin

5 月 15 日凌晨,Google I/O 开发者大会正式召开,以下是长达 2 小时发布会内容总结:

1. 关于 Gemini

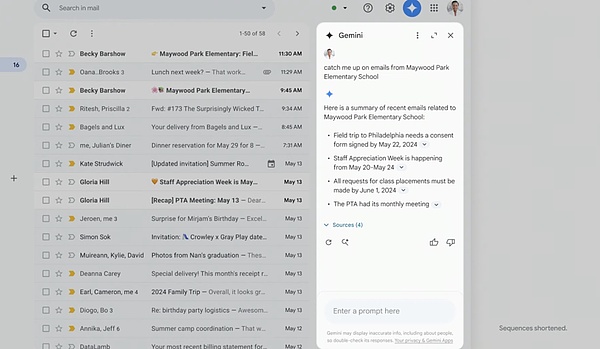

1)Gmail 中的 Gemini

Gmail 用户将能够使用 Gemini AI 技术搜索、总结和起草电子邮件。它还能够对电子邮件采取行动以执行更复杂的任务,例如通过搜索收件箱、查找收据和填写在线表格来帮助你处理电商退货。

2)Gemini 1.5 Pro & Flash

另一个升级是 Gemini 现在可以分析比以前更长的文档、代码库、视频和音频记录。谷歌目前的旗舰机型 Gemini 1.5 Pro 新版本的私人预览中,据透露,它最多可以容纳 200 万 token。这是之前的两倍,新版 Gemini 1.5 Pro支持所有商用型号中最大的输入。

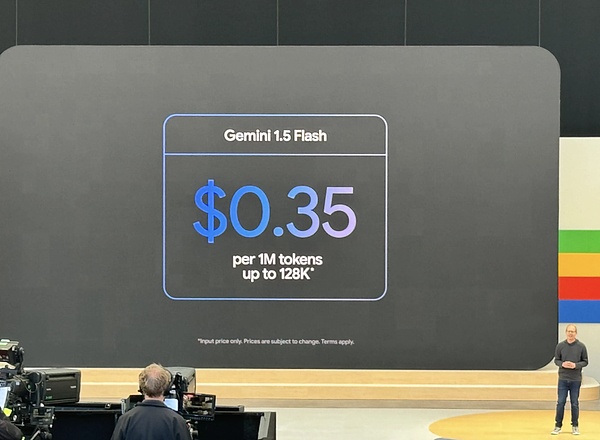

对于要求较低的应用,谷歌推出了公共预览版 Gemini 1.5 Flash,这是 Gemini 1.5 Pro 的“精炼”版本,是专为“窄”、“高频”生成 AI 工作负载而构建的小型高效模型。Flash 拥有多达 200 万个 token 上下文窗口,与 Gemini 1.5 Pro 一样是多模式的,这意味着它可以分析音频、视频和图像以及文本。

此外,超过 150 个国家/地区和超过 35 种语言的 Gemini Advanced 用户可以利用 Gemini 1.5 Pro 的更大上下文,让聊天机器人分析、总结和回答有关长文档(最多 1,500 页)的问题。

Gemini Advanced 用户可以从今天开始与 Gemini 1.5 Pro 进行交互,还可以从 Google Drive 导入文档或直接从移动设备上传文档。

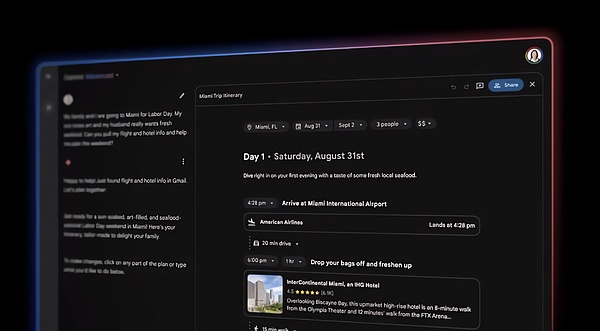

在接下来的几个月中,Gemini Advanced 将获得一种新的“规划体验”,可以根据提示创建自定义旅行行程。考虑到飞行时间(来自用户 Gmail 收件箱中的电子邮件)、膳食偏好和当地景点信息(来自 Google 搜索和地图数据)以及这些景点之间的距离等因素,Gemini 将生成自动更新的行程以反映任何变化。

在不久的将来,Gemini Advanced 用户将能够创建 Gems,这是由 Google Gemini 模型提供支持的自定义聊天机器人。沿着 OpenAI 的 GPT 的思路,Gems 可以从自然语言描述生成 - 例如,“你是我的跑步教练。给我一个每日跑步计划”——并与他人分享或保密。

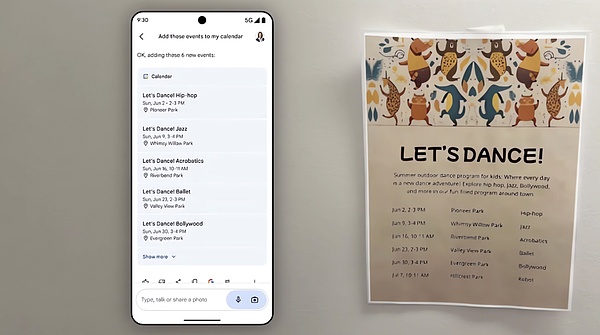

很快,Gems 和 Gemini 将能够利用与 Google 服务的扩展集成,包括 Google 日历、任务、Keep 和 YouTube Music,以完成各种省力任务。

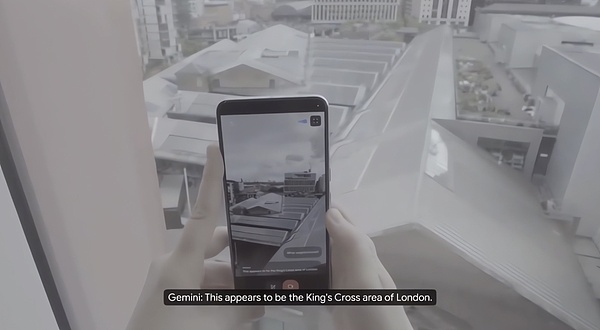

3)Gemini Live

谷歌预览了 Gemini 中名为 Gemini Live 的新体验,它可以让用户在智能手机上与 Gemini 进行“深入”的语音聊天。

用户可以在聊天机器人说话时打断 Gemini,提出澄清问题,它会实时适应他们的语音模式。Gemini 可以通过智能手机摄像头拍摄的照片或视频来查看用户的周围环境并对其做出反应。

谷歌表示,它利用生成式 AI 新技术来提供卓越的、不易出错的图像分析,并将这些技术与增强的语音引擎相结合,以实现更一致、情感表达和现实的多轮对话。

从某种程度上来说,Gemini Live 是Google Lens(谷歌长期用于分析图像和视频的计算机视觉平台)和 Google Assistant(谷歌跨手机、智能音箱和电视的人工智能驱动、语音生成和识别虚拟助手)的演变 。

DeepMind 首席科学家 Oriol Vinyals 表示,这是一个实时语音界面,具有极其强大的多模式功能和长上下文。

推动 Live 的技术创新部分源于 Project Astra,这是 DeepMind 内部的一项新举措,旨在创建 AI 驱动的应用和智能体,以实现实时、多模式理解。

DeepMind CEO Demis Hassabis 表示,谷歌一直希望打造一款在日常生活中有用的通用智能体,想象一下代理可以看到和听到我们所做的事情,更好地了解我们所处的环境并在对话中快速做出反应,从而使交互的速度和质量感觉更加自然。

据悉,Gemini Live 直到今年晚些时候才会推出,它可以回答有关智能手机摄像头视野内(或最近视野内)事物的问题,例如用户可能位于哪个社区或损坏的自行车上的某个部件的名称。指向计算机代码的一部分,Live 可以解释该代码的作用。或者,当被问及一副眼镜可能在哪里时,Live 可以说出它最后一次“看到”眼镜的位置。

Live 还被设计为某种虚拟教练,帮助用户排练活动、集思广益等。例如,Live 可以建议在即将到来的工作或实习面试中强调哪些技能,或者提供公开演讲建议。

新的 ChatGPT 和 Gemini Live 之间的一个主要区别是 Gemini Live 不是免费的。一旦推出,Live 将是 Gemini Advanced 的专属版本,Gemini Advanced 是 Gemini 的更复杂版本,受 Google One AI Premium Plan 保护,价格为每月 20 美元。

4)Gemini Nano

谷歌还从 Chrome 126 开始,将最小的 AI 模型 Gemini Nano 直接构建到 Chrome 桌面客户端中。谷歌表示,这将使开发人员能够使用设备上的模型来支持自己的 AI 功能。例如,谷歌计划利用这一新功能来支持 Gmail 中 Workspace Lab 现有的“帮助我写作”工具等功能。

谷歌 Chrome 产品管理总监 Jon Dahlke 指出,谷歌正在与其他浏览器供应商进行谈判,以便在他们的浏览器中启用此功能或类似功能。

谷歌 Chrome 产品管理总监 Jon Dahlke 指出,谷歌正在与其他浏览器供应商进行谈判,以便在他们的浏览器中启用此功能或类似功能。

5)Android 上的 Gemini

谷歌在 Android 上的 Gemini 是 Google Assistant 的 AI 替代品,很快将利用其与 Android 移动操作系统和谷歌应用程序深度集成的能力。

用户将能够将 AI 生成的图像直接拖放到他们的 Gmail、Google Messages 和其他应用程序中。

谷歌表示,与此同时,YouTube 用户将能够点击“询问此视频”,从该 YouTube 视频中查找特定信息。

购买升级版 Gemini Advanced的用户还可以使用“询问此 PDF”选项,让您无需阅读所有页面即可从文档中获得答案。Gemini Advanced 订阅者每月支付 19.99 美元即可访问 AI,并获得 2TB 存储空间以及其他 Google One 福利。

谷歌表示,Android 版 Gemini 的最新功能将在未来几个月内推广到数亿受支持的设备。随着时间的推移,Gemini 将不断发展,提供与屏幕上的内容相关的其他建议。

与此同时,Android 设备上的基础模型 Gemini Nano 将升级以包含多模态。这意味着它将能够处理文本输入以及其他处理信息的方式,包括视觉、声音和口语。

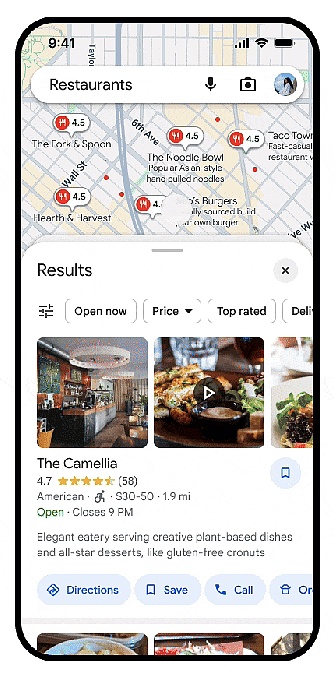

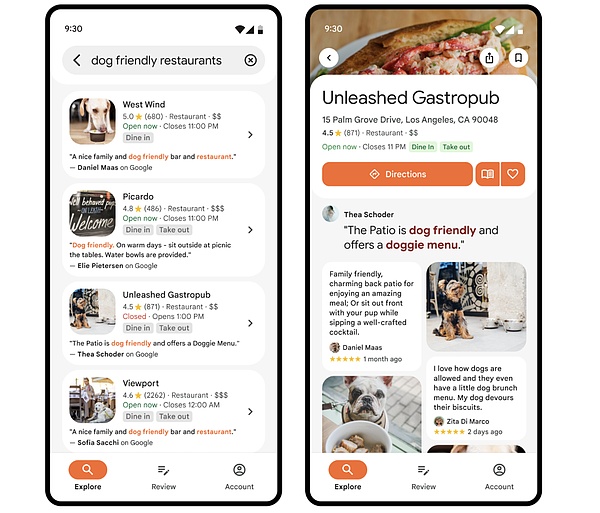

6)谷歌地图上的 Gemini

从 Places API 开始,Gemini 模型功能将登陆 Google 地图平台供开发者使用。开发人员可以在自己的应用程序和网站中显示地点和区域的生成 AI 摘要。这些摘要是基于 Gemini 对 Google 地图社区超过 3 亿贡献者的见解分析而创建的。

这些摘要是基于 Gemini 对 Google 地图社区超过 3 亿贡献者的见解分析而创建的。借助这项新功能,开发人员将不再需要编写自己的自定义地点描述。

例如,如果开发人员有一个餐厅预订应用程序,这项新功能将帮助用户了解哪家餐厅最适合他们。当用户在应用程序中搜索餐厅时,他们将能够快速查看所有最重要的信息,例如餐厅特色菜、欢乐时光优惠和餐厅氛围。

新的摘要适用于多种类型的场所,包括餐馆、商店、超市、公园和电影院。谷歌还将 AI 驱动的上下文搜索结果引入 Places API。当用户在开发者的产品中搜索地点时,开发者现在可以显示与其搜索相关的评论和照片。

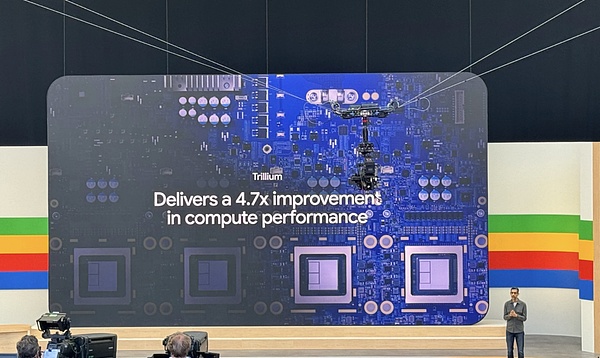

7)TPU 性能得到提升

谷歌推出了下一代——确切地说是第六代——TPU AI 芯片。它们被称为 Trillium,将于今年晚些时候推出。如果您还记得的话,宣布下一代 TPU 已成为 I/O 大会上的一项传统,尽管这些芯片仅在今年晚些时候推出。

与第五代相比,这些新型 TPU 的每芯片计算性能将提高 4.7 倍。Trillium 具有第三代 SparseCore,谷歌将其描述为“用于处理高级排名和推荐工作负载中常见的超大型嵌入的专用加速器。

Pichai 将新芯片描述为谷歌迄今为止“最节能”的 TPU,随着对 AI 芯片的需求持续呈指数级增长,这一点尤其重要。

他表示,过去六年,行业对 ML 计算的需求增长了 100 万倍,每年大约增长十倍,如果不投资降低这些芯片的功耗需求,这是不可持续的。谷歌承诺,新型 TPU 的能效比第五代芯片高 67%。

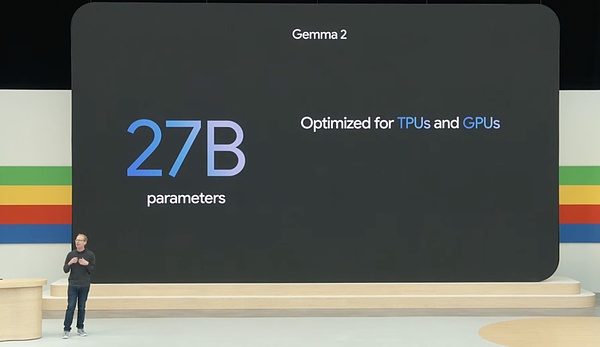

此外,谷歌在 Gemma 2 中添加一个新的 270 亿参数模型。下一代谷歌 Gemma 模型将于 6 月推出。谷歌表示,这个尺寸经过 Nvidia 优化,可以在下一代 GPU 上运行,并且可以在单个 TPU 主机和顶点 AI 上高效运行。

2. 新模型&项目

1)Imagen3

谷歌推出了 Imagen 模型的最新产品 —— Imagen 3。DeepMind CEO Demis Hassabis 表示,与前身 Imagen 2 相比,Imagen 3 能够更准确地理解翻译成图像的文本提示,并且比前几代产品更加富有创意和细致。

谷歌推出了 Imagen 模型的最新产品 —— Imagen 3。DeepMind CEO Demis Hassabis 表示,与前身 Imagen 2 相比,Imagen 3 能够更准确地理解翻译成图像的文本提示,并且比前几代产品更加富有创意和细致。

为了减轻人们对深度伪造的可能性的担忧,谷歌表示 Imagen 3 将使用SynthID,这是 DeepMind 开发的一种方法,可将不可见的加密水印应用于媒体。

谷歌的 ImageFX 工具可以注册 Imagen 3 的私人预览版,谷歌表示,该模型将“很快”提供给使用谷歌企业生成式 AI 开发平台 Vertex AI 的开发人员和企业客户。

2)Veo 视频生成模型

谷歌正在瞄准 OpenAI 的 Sora with Veo,这是一种 AI 模型,可以根据文本提示创建大约一分钟长的 1080p 视频剪辑。Veo 可以捕捉不同的视觉和电影风格,包括风景和延时镜头,并对已生成的镜头进行编辑和调整。

它还建立在谷歌在四月份预览的视频生成方面的初步商业工作的基础上,该工作利用该公司的 Imagen 2 系列图像生成模型来创建循环视频剪辑。

Demis Hassabis 表示,谷歌正在探索故事板和生成更长场景等功能,以了解 Veo 的功能,谷歌在视频方面取得了令人难以置信的进步。

Veo 接受了大量镜头的训练。这就是生成式 AI 模型的工作原理:输入某种形式数据的一个又一个示例,模型会拾取数据中的模式,使它们能够生成新数据——在 Veo 的例子中是视频。

然而,谷歌已经向选定的创作者提供了 Veo,其中包括 Donald Glover(又名 Childish Gambino)和他的创意机构 Gilga。

3)LearnLM 模型

谷歌推出了 LearnLM,这是一个针对学习进行“微调”的新生成 AI 模型系列。这是谷歌 DeepMind AI 研究部门和谷歌研究院之间的合作。谷歌表示,LearnLM 模型旨在“对话式”辅导学生一系列科目。

LearnLM 已经在 Google 的多个平台上可用,且正在通过 Google Classroom 的试点项目来使用 LearnLM。谷歌表示,LearnLM 可以帮助教师发现新的想法、内容和活动,或者找到适合特定学生群体需求的材料。

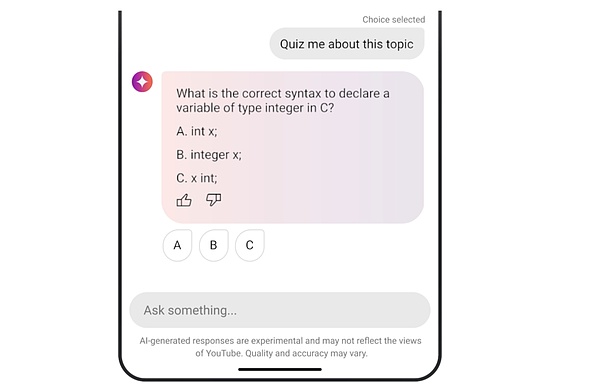

YouTube 的新功能是 AI 生成的测验。这种新的对话式 AI 工具允许用户在观看教育视频时象征性地“举起”手。观众可以提出澄清问题、获得有用的解释或就主题进行测验。

由于 Gemini 模型的长上下文功能,这对于那些必须观看较长教育视频(例如讲座或研讨会)的人来说会有所缓解,这些新功能正在向美国部分 Android 用户推出。

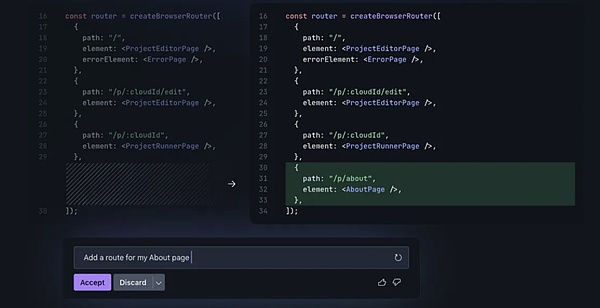

4)Project IDX

Project IDX 是谷歌下一代、以 AI 为中心、基于浏览器的开发环境,现已进入公开测试阶段。

谷歌副总裁兼 Developer X 总经理兼负责人 Jeanine Banks 表示,随着 AI 变得越来越普遍,部署所有这些技术所带来的复杂性确实变得越来越困难、越来越大,谷歌希望帮助解决这一挑战。开发商关系,这就是构建 Project IDX 的原因。

IDX 是一种多平台开发体验,可以让构建应用程序变得快速、轻松,你可以通过 Next.js、Astro、Flutter、Dart、Angular、Go 等易于使用的模板轻松使用您喜欢的框架或语言。

此外,Google 将与 Google Maps Platform 的集成添加到 IDE 中,帮助向其应用程序添加地理定位功能,并与 Chrome 开发工具和 Lighthouse 集成以帮助调试应用程序。很快,谷歌还将支持将应用程序部署到 Cloud Run,这是 Google Cloud 的无服务器平台,用于运行前端和后端服务。

该开发环境还将与谷歌 AI 驱动的合规平台 Checks 集成,该平台本身将于周二从测试版转为正式版。当然,IDX 不仅仅是构建支持 AI 的应用程序,它还涉及在编码过程中使用 AI。

为了实现这一点,IDX 包括许多现已成为标准功能的功能,例如代码完成和聊天助手侧边栏,以及创新功能,例如突出显示代码片段的功能,以及类似于 Photoshop 中的生成填充功能,询问 Google 的 Gemini 模型更改代码片段。

每当 Gemini 建议代码时,它都会链接回原始来源及其相关许可证。Project IDX 是 Google 以开源 Visual Studio Code 为核心构建的,它还与 GitHub 集成,可以轻松地与现有工作流程集成。在 IDX 的最新版本之一中,Google 还在IDE 中为移动开发人员添加了内置 iOS 和 Android 模拟器。

3. 应用&工具更新

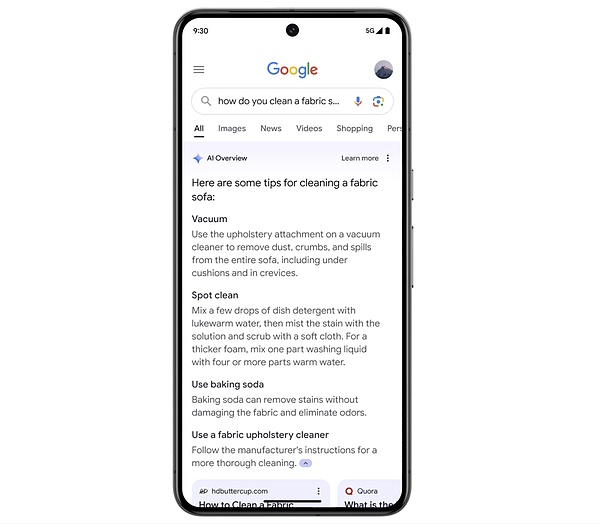

1)AI 在搜索中的应用

谷歌搜索主管 Liz Reid 表示,谷歌为搜索构建了定制的 Gemini 模型,将实时信息、谷歌排名、长上下文和多模态特征结合在一起。

谷歌正在其搜索中添加更多 AI ,缓解了人们对该公司正在将市场份额输给 ChatGPT 和 Perplexity 等竞争对手的疑虑。

谷歌正在向美国用户推出 AI 驱动的概述。此外,该公司还希望使用 Gemini 作为旅行计划等事务的智能体。

谷歌计划使用生成式 AI 来组织某些搜索结果的整个搜索结果页面。这是对现有 AI 概述功能的补充,该功能会创建一个简短的片段,其中包含有关您正在搜索的主题的聚合信息。经过谷歌 AI 实验室计划的一段时间后, AI 概述功能将于周二全面开放。

自去年以来,谷歌一直在通过其搜索生成体验(SGE)测试 AI 驱动的概述。现在,它将于本周在美国向“数亿用户”推出,目标是在今年年底前向超过 10 亿人提供服务。

她还表示,在其 AI 概述功能的测试期间,谷歌观察到人们点击了更加多样化的网站。当传统搜索足以提供结果时,用户将看不到 AI 概述,该功能对于比较复杂、信息分散的查询更有用。

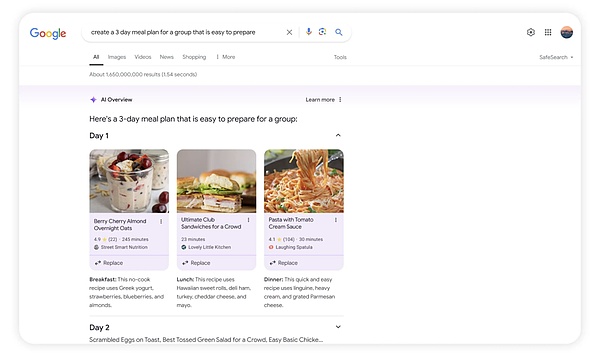

此外,谷歌还希望使用 Gemini 作为智能体 Agent 来完成膳食或旅行计划等任务。用户可以输入诸如“为四口之家计划三天的膳食”之类的查询,并获取这三天的链接和食谱。

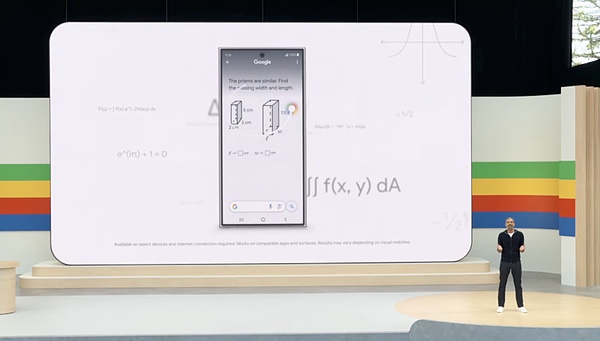

2)圈选搜索

由 AI 驱动的“圈搜索”功能允许 Android 用户使用转圈等手势立即获得答案,现在将能够解决更复杂的心理学和数学应用题。

它的设计目的是让用户在手机上的任何地方都可以更自然地通过一些操作(例如圈选、突出显示、涂鸦或点击)来使用 Google 搜索。

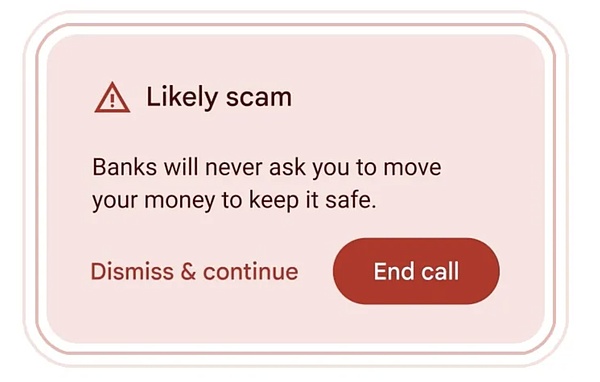

3)在通话过程中检测诈骗

谷歌预览了一项功能,它认为该功能将在通话过程中提醒用户注意潜在的诈骗。

该功能将内置于 Android 的未来版本中,它利用 Gemini Nano,这是 Google 生成式 AI 产品的最小版本,可以完全在设备上运行。该系统有效地实时监听“通常与诈骗相关的对话模式”。

谷歌举了一个假装是“银行代表”的例子。密码请求和礼品卡等常见的诈骗策略也会触发该系统。这些都是众所周知的从你身上榨取钱财的方式,但世界上有很多人仍然容易受到此类骗局的侵害。一旦启动,它会弹出一条通知,提示用户可能会成为令人讨厌的角色的牺牲品。

4)询问照片

谷歌照片正在注入 AI ,推出了一项实验性功能“Ask Photos”,该功能由谷歌的 Gemini AI 模型提供支持。今年夏天晚些时候推出的新功能将允许用户使用自然语言查询来搜索他们的 Google 照片集,这些查询利用了 AI 对其照片内容和其他元数据的理解。

虽然在用户可以搜索照片中的特定人物、地点或事物之前,借助自然语言处理, AI 升级将使找到正确的内容更加直观,减少手动搜索过程。

5)Firebase Genkit

Firebase 平台新增了一个名为 Firebase Genkit 的功能,旨在让开发人员更轻松地使用 JavaScript/TypeScript 构建 AI 驱动的应用,并且即将推出对 Go 的支持。

Firebase 平台新增了一个名为 Firebase Genkit 的功能,旨在让开发人员更轻松地使用 JavaScript/TypeScript 构建 AI 驱动的应用,并且即将推出对 Go 的支持。

它是一个开源框架,使用 Apache 2.0 许可证,使开发人员能够快速将 AI 构建到新的和现有的应用程序中。

此外,谷歌重点介绍 Genkit 的一些用例,包括许多标准 GenAI 用例:内容生成和摘要、文本翻译和生成图像。

6)Google Play

Google Play 凭借新的应用发现功能、获取用户的新方式、Play Points 更新以及面向开发者的工具(例如 Google Play SDK Console 和 Play Integrity API 等)的其他增强功能而受到了一些关注。

开发人员特别感兴趣的是名为 Engage SDK 的东西,它将为应用程序制造商引入一种方式,以针对个人用户的个性化全屏、沉浸式体验向用户展示其内容。不过,谷歌表示,用户目前无法看到这个表面。

更多新闻 google开发者大会2024

- 6月 19, 2024 12:26 中午100+团队在DoraHacks.io申请全球以太坊开发者大会EDCON 2024 Super Demo Day全球以太坊开发者大会 EDCON 2024 Super Demo Day 已在全球极客运动平台 DoraHacks.io 结束申请。 作为 EDCON 2024 官方指定的唯一报名平台,DoraHacks 收到了超过 100 支团队的报名申请,其中 70 个团队通过了初审。这些项目涵盖了互操作性解决方案、消费级应用、ReFi、AI 加密应用和 DePin 等赛道。首批入围的 40 个项目将于下周公布,并进行线上展示和评选。 Super Demo Day 是由 EDCON 主办的 Web3 创业项目展示日。入选最终线下 Super Demo Day 的团队将受邀在日本东京的 EDCON 主会场向全球一线投资人和孵化器展示他们的项目。最终排名前三的项目将共享 10,000 美元奖金池。

- 6月 17, 2024 6:25 晚上OpenBuild 和星网基金会启动 2024 开发者季据《前瞻新闻》报道,OpenBuild 和星网基金会联合发起了 2024 开发者季。这一系列活动包括在线 Bootcamp、黑客马拉松和线下 Hackerhouse。Starknet DeFi Bootcamp 将于 7 月 1 日正式启动,现已开放注册。黑客马拉松计划于七月启动,优秀项目可直接推荐申请星网官方资助。 本次活动支持中英文两种语言,旨在帮助和支持全球开发者加深对星网生态系统的理解和建设。本次活动得到了 Chakra、Chainlink、The Graph、SNZ 和 Reddio 的大力支持。星网中文社区、西班牙社区、法国社区、非洲社区和其他全球社区提供了社区支持。活动还得到了国内外开发者社区、高校区块链协会和媒体的支持。

- 6月 11, 2024 4:43 凌晨与人工智能相关的加密货币在苹果开发者大会后下跌据 CoinDesk 报道,苹果公司的年度开发者活动包括公布其人工智能(AI)计划,导致该公司股价下跌近 2%。这对与人工智能相关的加密货币产生了连锁反应,这些加密货币在更广泛的数字资产市场上表现不佳。 与人工智能相关的加密货币,如 Render(RNDR)、Fetch.ai(FET)和 SingularityNET(AGIX),在过去 24 小时内下跌了 3%-5%。Bittensor 的 TAO 也经历了大幅下跌,同期跌幅接近 6%。第一层网络近协议(Near Protocol)也下跌了 3.2%。 CoinDesk 计算指数(CoinDesk Computing Index)包括了与人工智能相关的代币,是数字资产中表现最差的板块之一。该指数当天市值下跌了 2.5%,表现逊于比特币和更广泛的数字资产基准 CoinDesk 20 指数。 苹果公司在苹果全球开发者大会(WWDC2024)上公布其人工智能计划的预期很高,因此出现了下跌。该公司宣布为iPhone、Mac和其他产品推出一套人工智能功能--苹果智能(Apple Intelligence),并与山姆-奥特曼(Sam Altman)的OpenAI合作,将ChatGPT集成到苹果软件中。尽管发布了这些消息,苹果公司的股价在收盘时还是下跌了近 2%,尽管美国主要股票指数略有上涨。

- 5月 27, 2024 8:34 早上苹果将在开发者大会上推出新的人工智能功能据 PANews 报道,苹果公司将在下个月的开发者大会上发布一系列新的人工智能功能。重点将放在日常消费者常用的工具上。被称为 "Project Greymatter "的核心战略将把人工智能工具整合到 Safari、照片和便签等关键应用中。其中一些功能将在设备上运行,而高性能需求将在 M2 Ultra 芯片的支持下由云端处理。 iOS 18 和 macOS 15 将推出语音备忘录转录、AI 照片增强、改进的 Spotlight 搜索、改进的 Safari 网页搜索和自动回复建议等功能。个人助理 Siri 将基于苹果自己的大语言模型进行升级,Apple Watch 上的 Siri 也将得到增强。 此外,苹果正在开发一项功能,根据用户文本创建自定义表情符号,并改进 iPhone 主屏幕的自定义功能(iOS 18 将支持应用图标自定义)。苹果强调了其隐私承诺,解释了基于云的人工智能如何维护数据安全,并正在与 OpenAI 洽谈整合其聊天机器人的事宜。

- 5月 22, 2024 11:43 中午微软在 Build 2024 开发者大会上发布 50 多项更新据PANews报道,5月22日,微软在美国西雅图召开了Build 2024开发者大会,这家科技巨头在会上宣布了50多项更新。这些更新从人工智能基础设施的建设到模型产品的实施不一而足。值得关注的更新包括:将个人智能助理转变为团队助理的Team Copilot;提供SaaS解决方案的实时智能Microsoft Fabric;带来全新前沿模型和多模态功能的Azure AI;以及更新的自主研发AI芯片Cobalt芯片。 微软首席执行官萨提亚-纳德拉(Satya Nadella)在大会开幕式上谈到了微软对计算机的两个梦想:一是让计算机理解我们,而不是我们理解计算机;二是让计算机帮助我们在信息不断增加的世界中有效地推理、规划和行动。 OpenAI 首席执行官阿尔特曼在会上透露了 OpenAI 的新模式。他表示,新模式和整体智能将是 OpenAI 下一个模型的关键。他声称,该模式将变得更智能、更强大、更安全,GPT-4o 将更快、更具成本效益。Altman 指出,该行业已经有一段时间没有经历平台革命了,但现在正在经历这样一个时期。他建议开发商抓住这一机遇,他说:"现在不是推迟计划或等待下一次机会的时候。这是一个特殊的时刻。在未来几年里,将会发生很多事情,很多伟大的新事物将开始出现。

- 5月 09, 2024 2:24 下午Solana 2024 Breakpoint大会公布首批嘉宾Solana 2024 Breakpoint 大会公布首批演讲嘉宾名单,其中包括 Bybit CEO Ben Zhou,OKX CIO Jason Lau,Circle CEO Jeremy Allaire,21.Co CEO Hany Rashwan,Visa Head of Crypto Guy Sheffield 及众多生态项目创始人。

- 4月 06, 2024 8:09 晚上Google起诉两名中国软件开发者,指控其利用虚假加密App进行诈骗Google日前于纽约联邦法院起诉两名中国软件开发者,指控其通过创建虚假加密应用程序,并引导超过 10 万人下载,实施“杀猪盘”诈骗。 Google指控深圳的 Yunfeng Sun 和中国香港的 Hongnam Cheung 自 2019 年以来创建了至少 87 个此类应用程序。其中一些是典型的“杀猪”骗局,犯罪者会通过消息应用程序与受害者进行对话,赢得他们的信任,然后说服他们投资虚假项目。 据悉,虚假应用程序包括名为 TionRT 和 SkypeWallet 的虚假加密货币交易平台,在用户投诉、Google调查后,将其删除。(DL News)

- 3月 27, 2024 7:43 早上苹果公司将在第 35 届全球开发者大会上重点介绍人工智能据 PANews 报道,苹果公司宣布将于 6 月 10 日至 14 日在线举行第 35 届全球开发者大会(WWDC)。业内人士表示,此次大会将主要关注人工智能。大会期间,该公司有望公布期待已久的人工智能战略。不过,苹果并不打算推出自己的生成式人工智能聊天机器人。据此前报道,该公司正在与谷歌和 OpenAI 等潜在合作伙伴洽谈,以提供生成式人工智能服务。

- 3月 31, 2023 7:33 早上Particle Network 和 LongHash Ventures 将于 4 月 14 日举办「钱包开发者大会 HK」Web3 中间件平台 Particle Network 和 LongHash Ventures 将于 4 月 14 日下午在香港湾仔港湾道 1 号君悦酒店联合举办 Wallet Developers Conference HK。大会将会有围绕钱包主题的 8 个不同垂直赛道的主题分享以及围绕钱包如何推动 Web3 Mass Adoption 的圆桌论坛。Cobo 联合创始人 Changhao Jiang、Conflux 联合创始人 Yuanjie Zhang、SafePal 联合创始人 Veronica、NodeReal 联合创始人 Xiaoguang Zhang、Biconomy 联合创始人 Aniket Jindal、.bit 联合创始人 Tim Yang、ConsenSys 全球 BD 负责人 Shuyao、Ultiverse 联合创始人 Frank Ma 等将在活动中分享他们的见解。